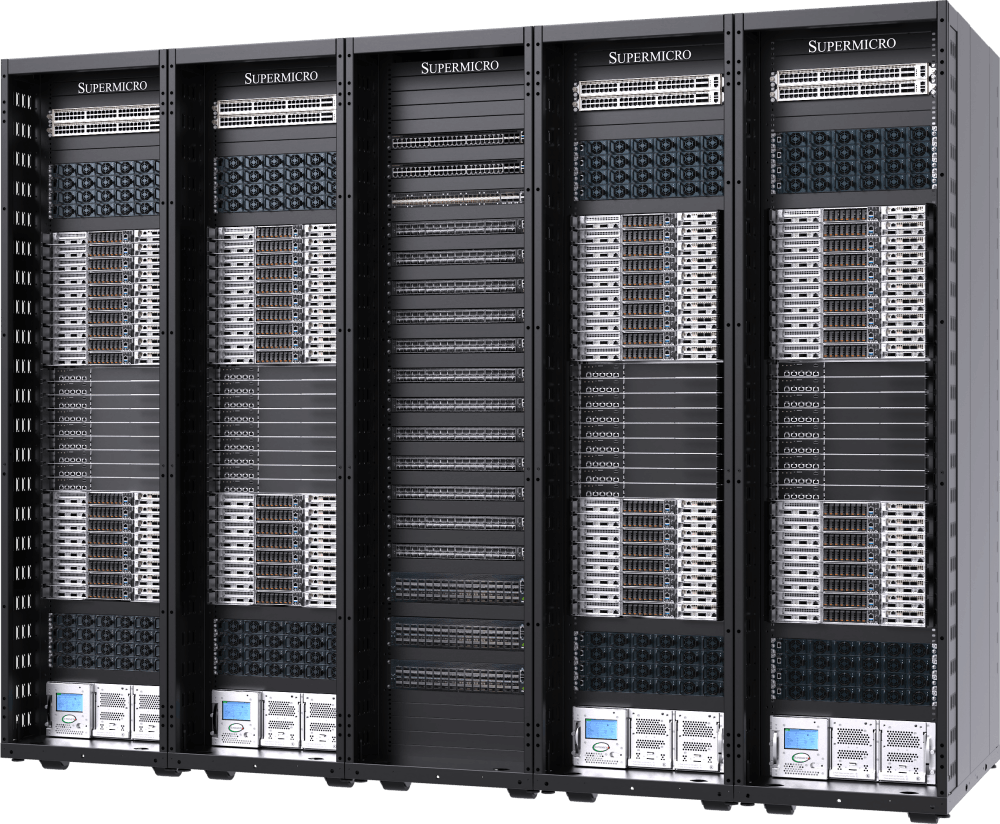

在AI时代,计算单元不再仅仅以服务器数量来衡量。互连的GPU、CPU、内存、存储以及机架中多个节点上的这些资源共同构建了当今的人工智能。基础设施需要高速、低延迟的网络架构,以及精心设计的散热技术和供电系统,以在每个数据中心环境中维持最佳性能和效率。Supermicro的SuperCluster解决方案为快速发展的生成式AI和大型语言模型 (LLM) 提供端到端的AI数据中心解决方案。

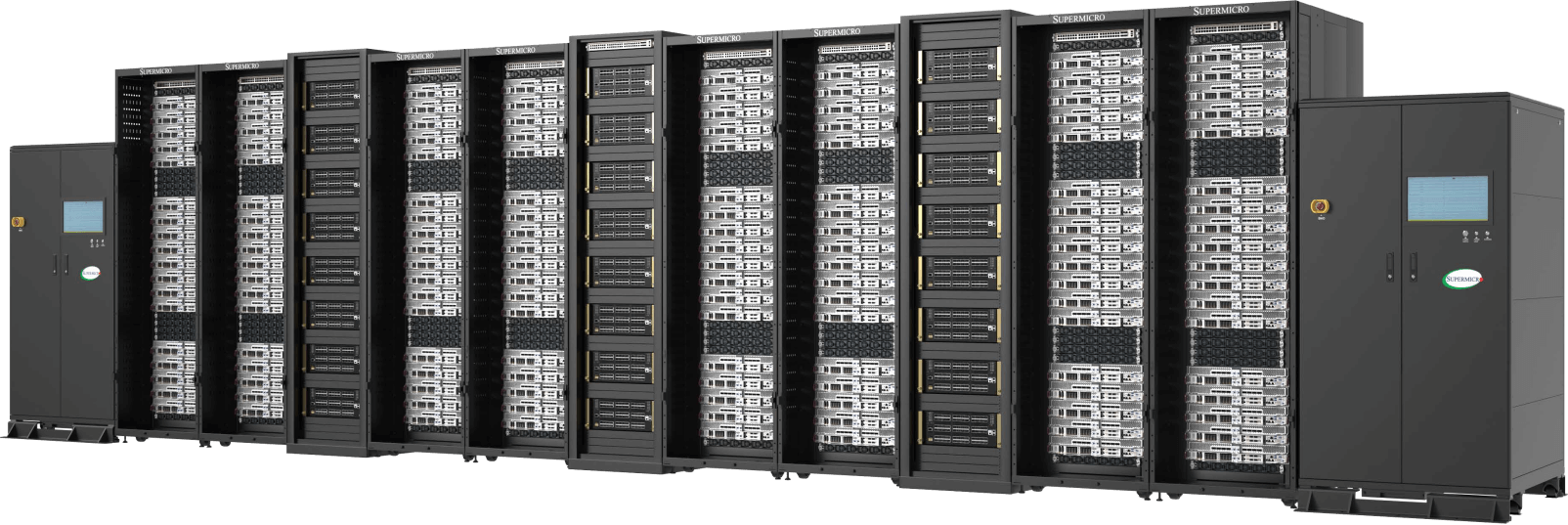

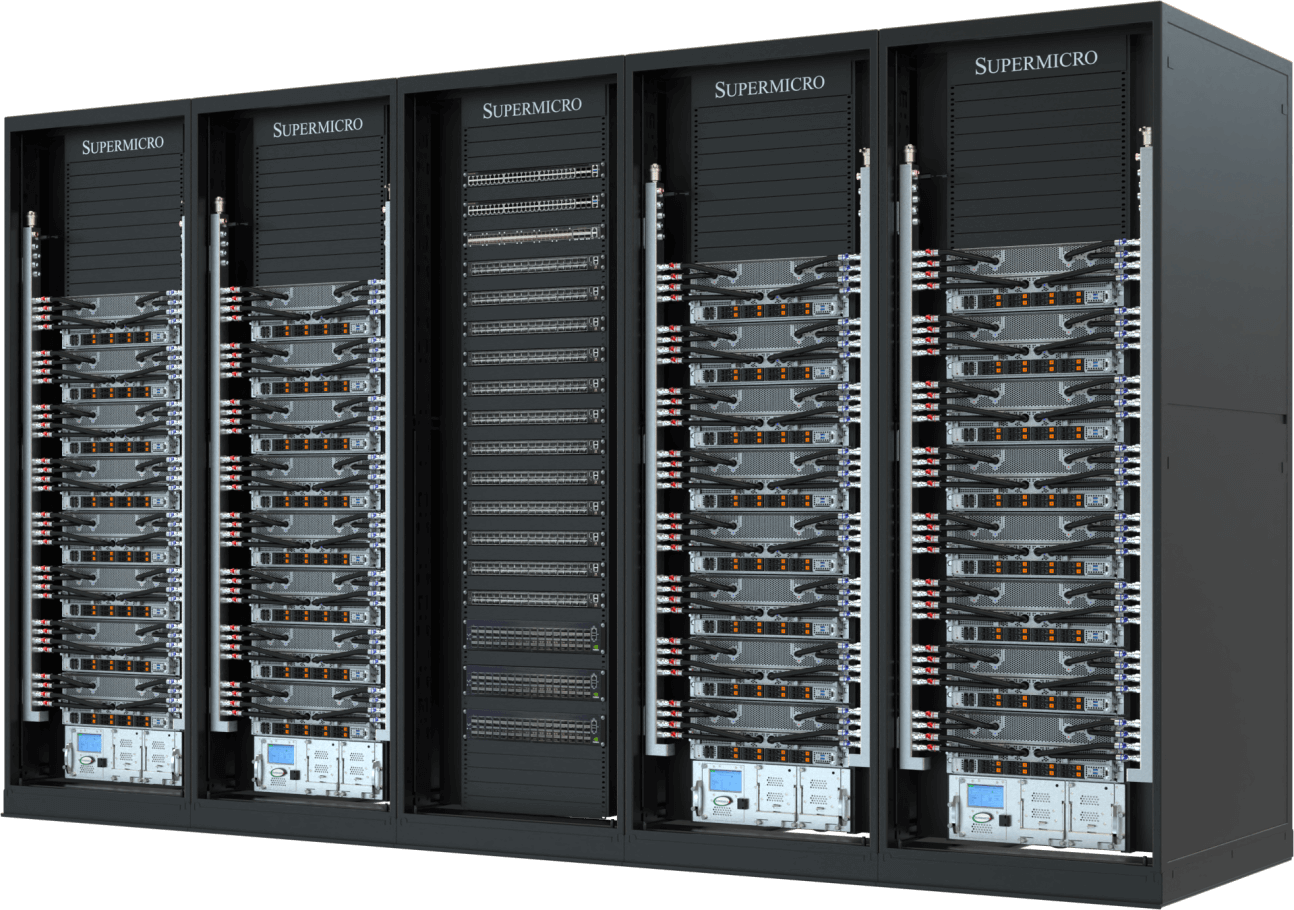

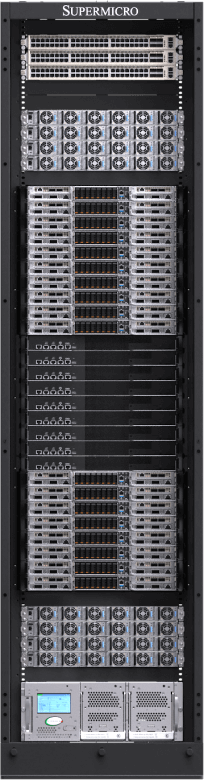

大规模完全集成

设计和建造全机架和集群,全球生产能力达 5,000 机架 每月

通过现场服务进行测试、验证和部署

经过验证的 L11、L12 测试流程可在发货前彻底验证运行效果和效率

液体冷却/空气冷却

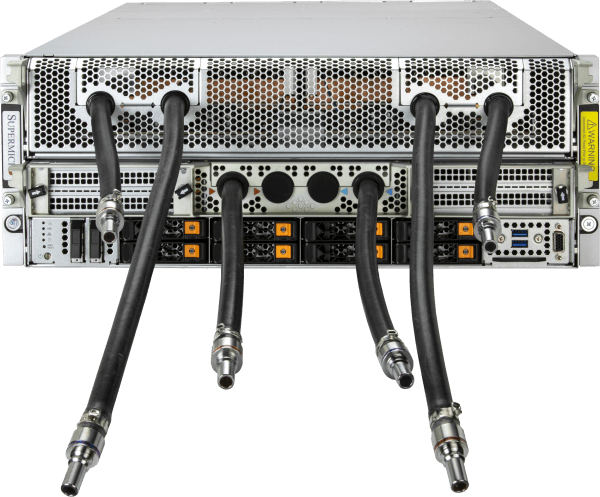

完全集成的液冷或风冷解决方案,包括 GPU 和 CPU 冷板、冷却分配器和歧管

供应和库存管理

一站式服务,快速、及时地提供完全集成的机架,缩短解决问题的时间,实现快速部署

全套交钥匙数据中心解决方案加快了关键任务企业用例的交付时间,并消除了构建大型集群的复杂性,而以前只有通过密集的设计调整和耗时的超级计算优化才能实现这一目标。

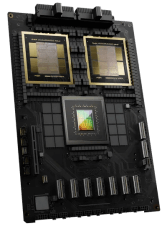

液冷式2UNVIDIA HGX B300人工智能集群

完全集成的液冷144节点集群,配备多达1152块NVIDIA B300 GPU

- NVIDIA HGX B300凭借紧凑型2-OU液冷系统节点,实现无与伦比的人工智能训练性能密度

- Supermicro 直接液冷,配备1.8MW容量的行级CDU(提供机架内CDU选项)

- 大型HBM3e GPU内存容量(每块GPU配备288GB* HBM3e内存)及基础模型训练所需的系统内存占用空间

- 采用NVIDIAQuantum-X800InfiniBand实现横向扩展,构建ultra、高带宽的人工智能架构

- 专用存储结构选项,全面支持NVIDIA GPUDirect RDMA与存储或RoCE技术

- 专为全面支持NVIDIA人工智能软件平台而设计,包括NVIDIA AI Enterprise和NVIDIA Run:ai。

计算节点

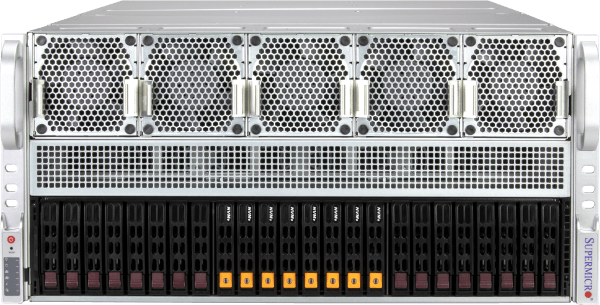

液冷式4U NVIDIA HGX B300人工智能集群

完全集成的液冷72节点集群,配备多达576块NVIDIA B300 GPU

- 部署高性能AI训练与推理,采用NVIDIA HGX B300,专为计算密度与可维护性优化设计

- Supermicro 直接液冷,专为持续高功率运行和提高能源效率而设计

- 大型HBM3e GPU内存容量(每块GPU配备288GB* HBM3e内存)及基础模型训练所需的系统内存占用空间

- 通过 NVIDIASpectrum™-X以太网或 NVIDIAQuantum-X800InfiniBand 实现横向扩展

- 专用存储结构选项,全面支持NVIDIA GPUDirect RDMA与存储或RoCE技术

- 专为全面支持NVIDIA人工智能软件平台而设计,包括NVIDIA AI Enterprise和NVIDIA Run:ai。

计算节点

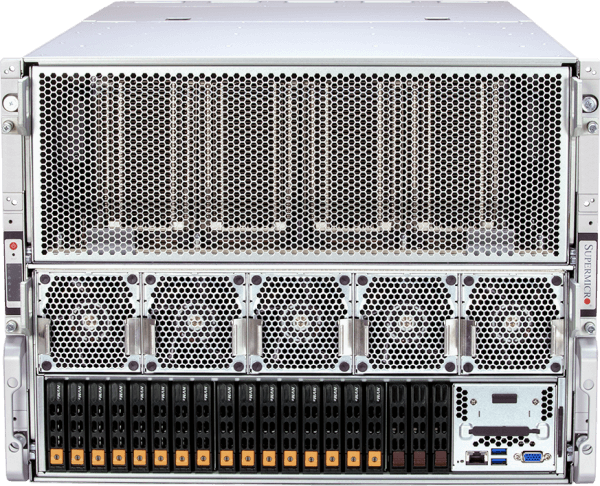

风冷式8U NVIDIA HGX B300人工智能集群

完全集成的风冷式 32 节点集群,配备多达 256 块 NVIDIA HGX B300 GPU 及总计 73.7TB 的 HBM3e 内存

- 基于参考架构的全栈解决方案,包括Supermicro 、NVIDIA GPU、NVIDIA 软件和 NVIDIA 网络解决方案

- 最多支持 256 块 NVIDIA HGX B300 GPU,提供高达 73.7TB 的总 HBM3e 内存(每块 GPU 配备 288GB HBM3e*)

- 与 NVIDIA 软件套件(NVIDIA AI Enterprise 和 NVIDIA Run:ai)的兼容性

- 即插即用解决方案,系统已完全集成到机架中,并在发货及现场部署前经过测试

- 通过 NVIDIASpectrum-X以太网计算架构或 NVIDIA Quantum-X800 InfiniBand 实现横向扩展;包含融合网络和带外管理功能

- Supermicro Factory 解决方案已获得 NVIDIA 认证,涵盖基础设施配置、Spectrum-X网络以及基于 NVIDIA HGX B300 企业参考架构的软件参考堆栈

计算节点

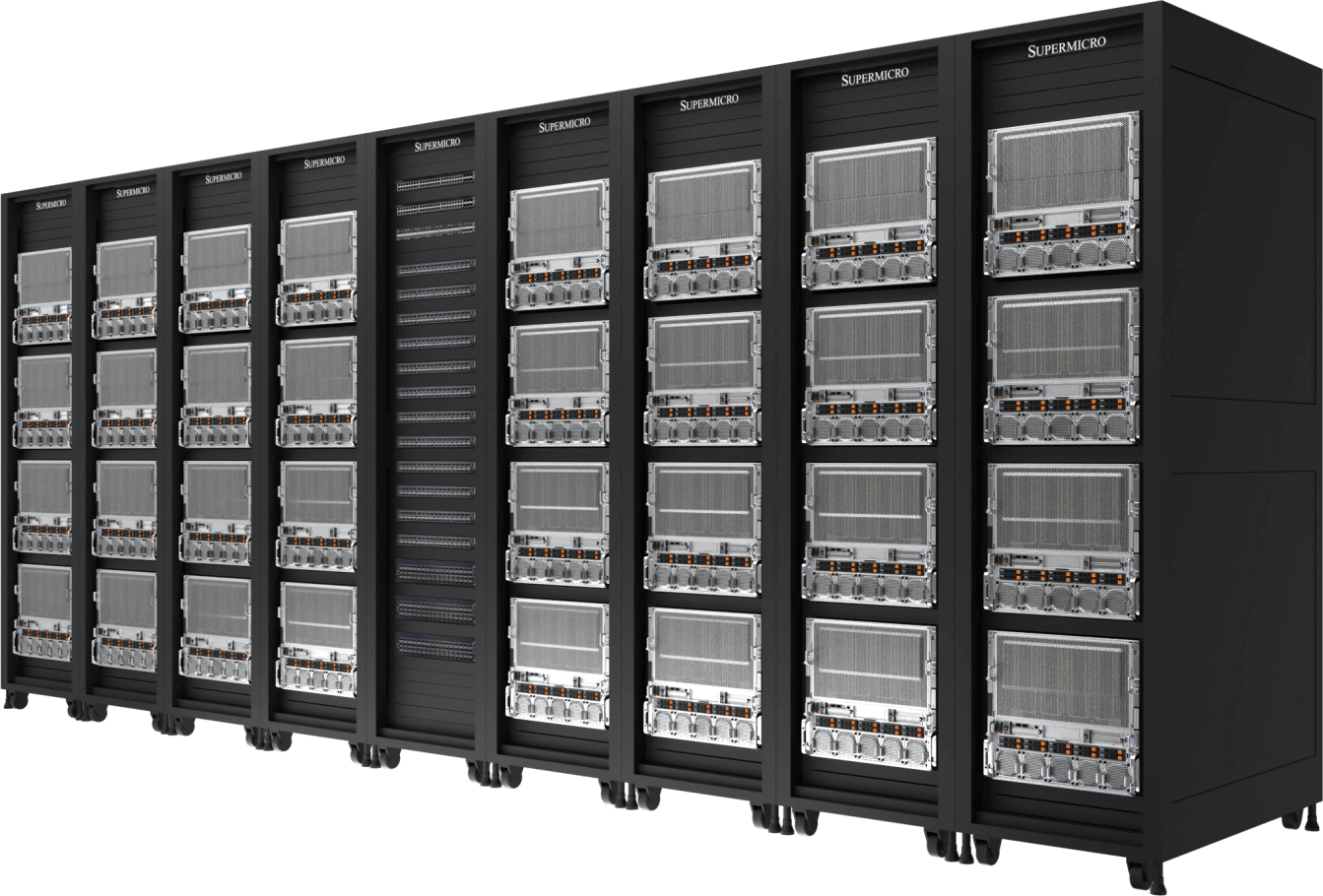

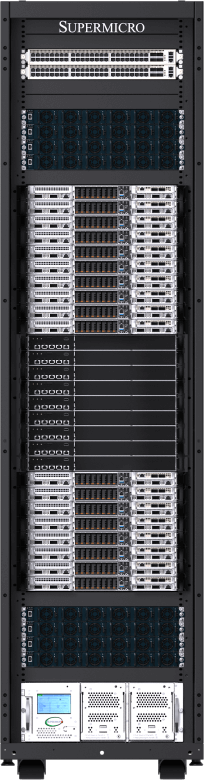

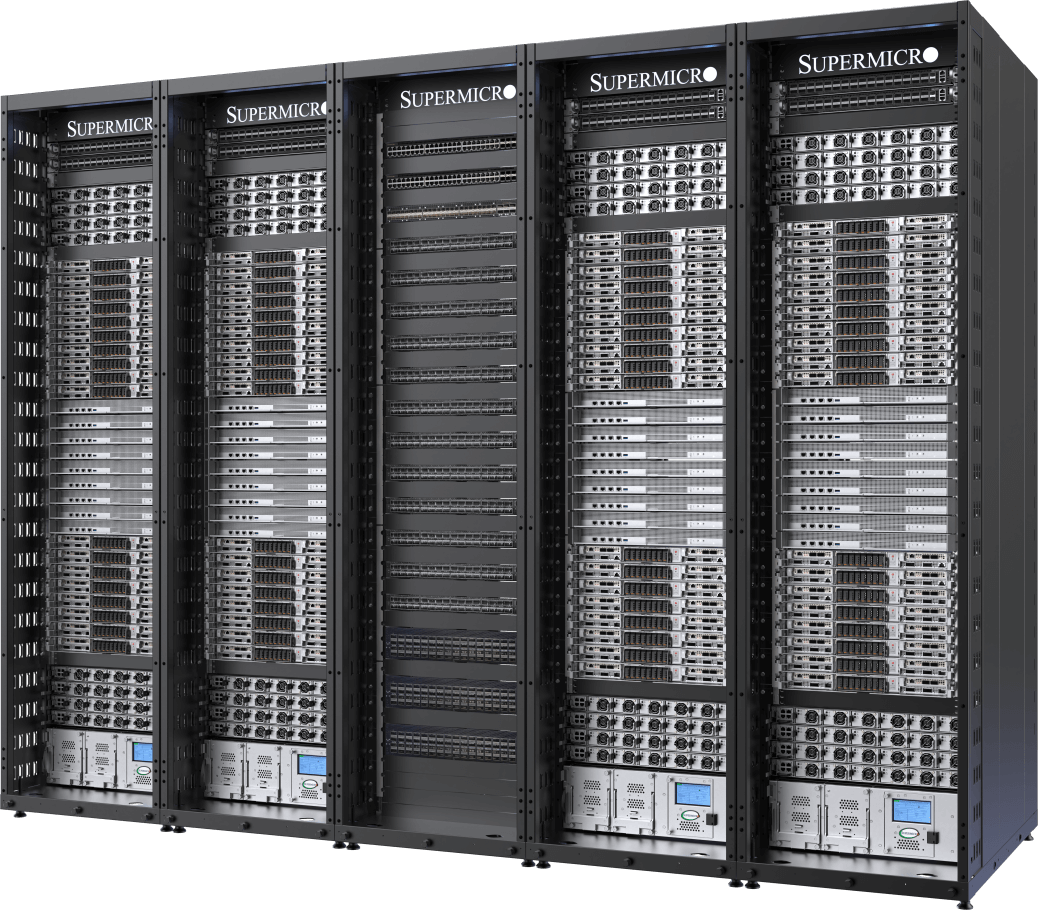

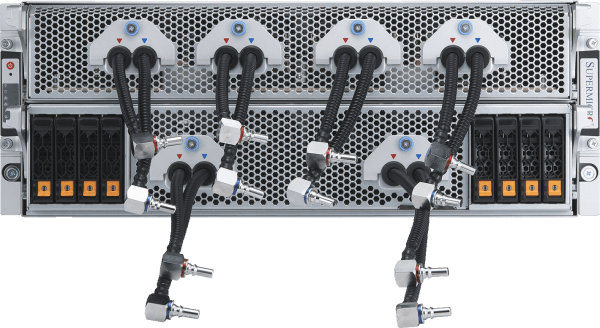

水冷式英伟达 HGX B200AI 集群

在5 个机架中最多可配备 32 个英伟达 HGX B200 8GPU 4U 液冷系统(256 个 GPU

- 部署256块NVIDIA B200 GPU的可扩展单元(5个机架),实现人工智能训练与推理性能的巅峰表现

- Supermicro 直接液冷解决方案,配备250kW机架式冷却液分配单元 (CDU),具备冗余电源和双热插拔泵

- 一个可扩展单元中包含 45 TB HBM3e 内存

- 利用 400Gb/s NVIDIASpectrum-X以太网或 NVIDIA Quantum-2 InfiniBand 进行扩展

- 专用存储结构选项,全面支持NVIDIA GPUDirect RDMA与存储或RoCE技术

- 专为全面支持NVIDIA人工智能软件平台而设计,包括NVIDIA AI Enterprise和NVIDIA Run:ai。

计算节点

风冷式英伟达 HGX B200 AI 集群

在9 个机架中配备 32 个 NVIDIA HGX B200 8GPU 10U 风冷系统(256 个 GPU

- 经过验证的行业领先架构,采用全新热优化风冷系统平台

- 一个可扩展单元中包含 45 TB HBM3e 内存

- 通过400Gb/s NVIDIASpectrum-X以太网或NVIDIAQuantum-2InfiniBand实现横向扩展

- 专用存储结构选项,全面支持NVIDIA GPUDirect RDMA与存储或RoCE技术

- NVIDIA认证系统节点,全面支持NVIDIA人工智能软件平台,包括NVIDIA AI Enterprise和NVIDIA Run:ai

计算节点

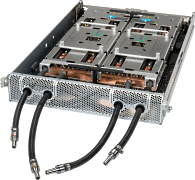

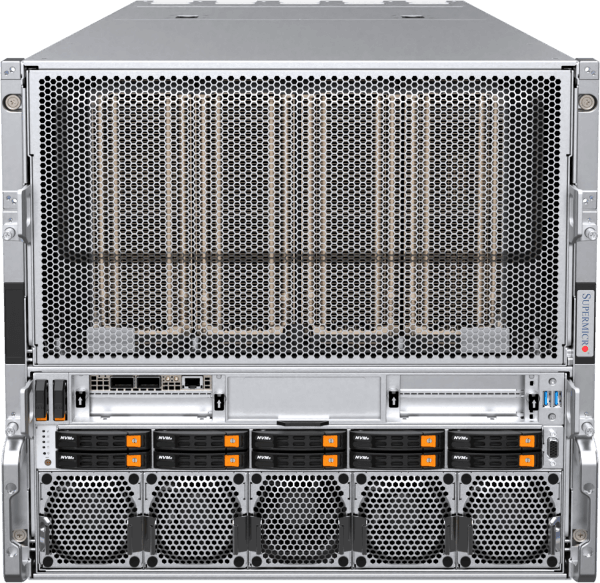

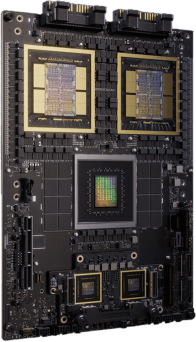

NVIDIA GB300 NVL72

单机架水冷式超大规模计算机

- 机架级解决方案,配备 NVIDIA GB300 Grace™ Blackwell 超级芯片,每个机架提供 72 个 NVIDIA B300 GPU 和 36 个 Grace CPU

- NVIDIA Blackwell Ultra,每颗GPUUltra 288GB HBM3e

- 直接液冷技术可将数据中心的电费降低多达 40%

- 提供从咨询到全面部署的一站式服务,涵盖所有必需的零部件、网络解决方案及现场安装服务

- 通过400Gb/s NVIDIASpectrum-X以太网或NVIDIAQuantum-2InfiniBand实现横向扩展

- 最高支持 800Gb/s 的 NVIDIA Quantum-2 InfiniBand 或Spectrum-X以太网,并集成 NVIDIA ConnectX®-8 SuperNIC

机架解决方案

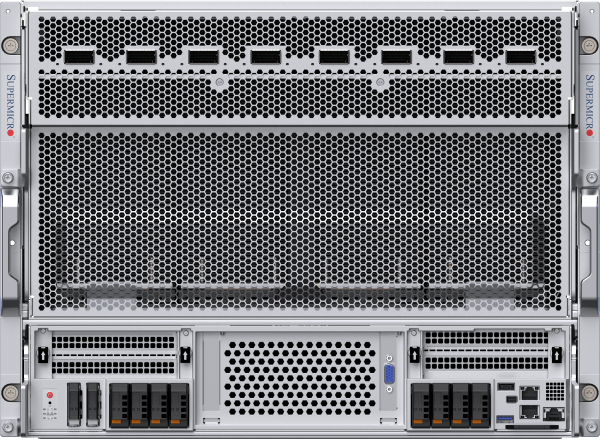

NVIDIA GB200 NVL72

单机架水冷式超大规模计算机

- 72块NVIDIA Blackwell B200 GPU以单GPU模式协同工作,配备海量HBM3e内存池(每机架13.5TB)

- 9x NVLink交换机,每个计算托盘配备4个端口,连接72个GPU,提供1.8TB/s的GPU间互连带宽。

- Supermicro 直接液冷解决方案,配备250kW机架式冷却液分配单元 (CDU),具备冗余电源和双热插拔泵

- 专用存储结构选项,全面支持NVIDIA GPUDirect RDMA与存储或RoCE技术

- 通过400Gb/s NVIDIASpectrum-X以太网或NVIDIAQuantum-2InfiniBand实现横向扩展

- 专为全面支持NVIDIA人工智能软件平台而设计,包括NVIDIA AI Enterprise和NVIDIA Run:ai。

机架解决方案

NVIDIA RTX PRO™ 超级集群

搭载 NVIDIA RTX PRO 6000 Blackwell 服务器版的 AI 工厂解决方案

- 基于参考架构的全栈解决方案,包括Supermicro 、NVIDIA GPU、NVIDIA 软件和 NVIDIA 网络解决方案

- 最多支持 256 块 NVIDIA RTX PRO 6000 Blackwell 服务器版 GPU,提供高达 24TB 的 GDDR7 内存

- 与 NVIDIA 软件套件(NVIDIA AI Enterprise、NVIDIA Omniverse 和 NVIDIA Run:ai)的兼容性

- 即插即用解决方案,系统已完全集成到机架中,并在发货及现场部署前经过测试

- 包含 NVIDIASpectrum-X以太网计算架构、融合网络及带外管理功能

- Supermicro Factory 解决方案已获得 NVIDIA 认证,涵盖基础设施配置、Spectrum-X网络以及基于 NVIDIA RTX PRO 6000 Blackwell 服务器版企业参考架构的软件参考堆栈

计算节点

领先的液冷人工智能集群

配备5个机架,内含32套NVIDIA HGX H200 8-GPU、4U液冷系统(共计256个GPU)

- 通过 Supermicro 的定制液冷解决方案实现计算密度翻倍,并将数据中心的电力成本降低高达 40%

- 一个可扩展单元内配备 256 块 NVIDIA H200 GPU

- 一个可扩展单元内集成了36TB HBM3e和H200

- 专用存储结构选项,全面支持NVIDIA GPUDirect RDMA与存储或RoCE技术

- 通过400Gb/s NVIDIASpectrum-X以太网或NVIDIAQuantum-2InfiniBand实现横向扩展

- NVIDIA认证系统节点,全面支持NVIDIA人工智能软件平台,包括NVIDIA AI Enterprise和NVIDIA Run:ai

计算节点

成熟的设计

9个机架中配备32套NVIDIA HGX H200 8-GPU、8U风冷系统(共计256个GPU)

- 经过验证的行业领先架构,适用于大规模人工智能基础设施部署

- 一个可扩展单元内配备 256 块 NVIDIA H200 GPU

- 一个可扩展单元内集成了36TB HBM3e和H200

- 通过400Gb/s NVIDIASpectrum-X以太网或NVIDIAQuantum-2InfiniBand实现横向扩展

- 可定制的人工智能数据管道存储结构,提供业界领先的并行文件系统选项

- NVIDIA认证系统节点,全面支持NVIDIA人工智能软件平台,包括NVIDIA AI Enterprise和NVIDIA Run:ai

计算节点