Supermicro

Validierte AMD -Systeme

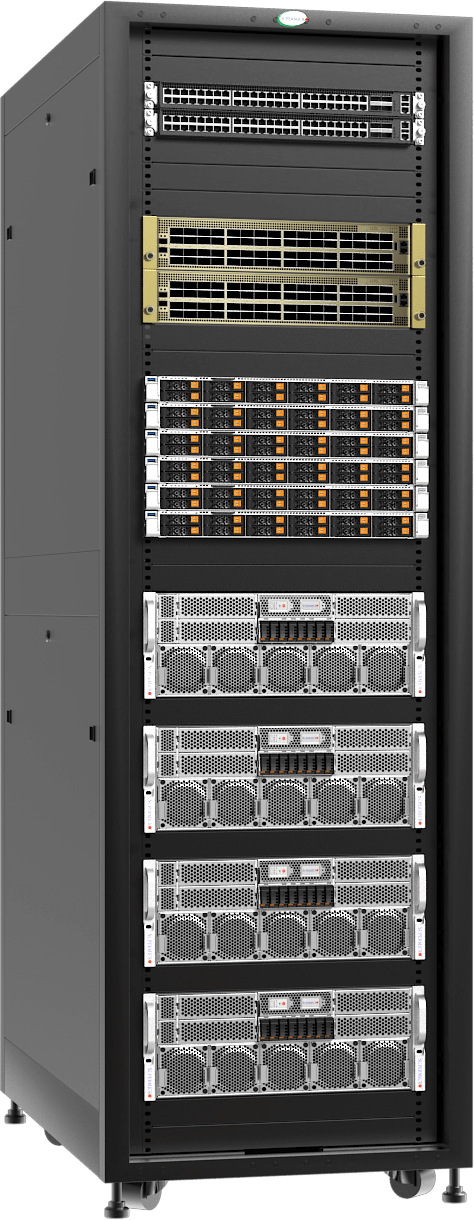

Rack-Scale-Integration, Tests und Validierung vor dem Versand

Bereitstellung, Dienste und Support im Cluster-Maßstab

Integration von Speicher und Netzwerken

AMD

AMD EPYC™

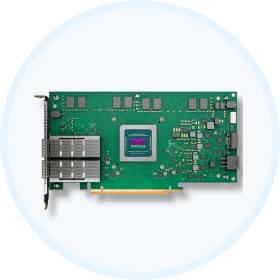

AMD Instinct™

AMD -Netzwerktechnologie

AMD software

Die Kombination der Rack-Scale-Integration Supermicromit den AMD bietet eine schlüsselfertige Infrastruktur, die speziell für die hohen Anforderungen einer modernen KI entwickelt wurde. Durch die Nutzung der Fachkompetenz Supermicroim Bereich der Flüssigkeitskühlung und der vorab validierten L11-Rack-Lösungen können Unternehmen Cluster unterschiedlicher Größe mit Beschleunigern der MI350-Serie mit optimaler thermischer Effizienz und minimalem Konfigurationsaufwand vor Ort bereitstellen. Dieses kooperative Ökosystem beschleunigt die Markteinführung erheblich, da Supermicro vor der Auslieferung eine Vorabvalidierung und Qualifizierung des gesamten Stacks Supermicro . Letztendlich reduziert diese Partnerschaft die Komplexität der Skalierung generativer KI und ermöglicht es Unternehmen, in Rekordzeit vom Delivery-Modus zum vollumfänglichen Modelltraining überzugehen.

AMD

GPUs setzen neue Maßstäbe für generative KI Hochleistungsrechnen, indem sie branchenführende Speicherkapazität und Bandbreite bieten – allen voran die 288 GB HBM3E und der Durchsatz von 8 TB/s des MI355X –, wodurch die nahtlose Ausführung der weltweit größten Sprachmodelle auf weniger Knoten ermöglicht wird.

AMD Software Stack

Der ROCm-Software-Stack bietet Kunden ein offenes, durchgängiges Ökosystem für führende Frameworks und Bibliotheken und vereinfacht in Verbindung mit der Enterprise-Suite den KI durch optimierte Microservices und Lösungsvorlagen.

AMD EPYC

Die Prozessoren bieten Spitzenleistung durch die Kombination einer branchenweit führenden Kernanzahl von bis zu 192 „Zen 5“-Kernen mit überragender Speicherbandbreite und bilden damit eine hocheffiziente Grundlage für durchgängige KI .

AMD

KI maximieren die Effizienz KI durch den Einsatz einer vollständig programmierbaren P4-Pipeline und Ultra -kompatiblen Funktionen – wie intelligentes Packet Spraying und pfadbewusste Überlastungskontrolle –, wodurch die Ausführungszeit von Aufträgen im Vergleich zu herkömmlichen RoCEv2-Lösungen um bis zu 20 % verkürzt wird.

Lagerung

Supermicro AMD mit führenden Speicheranbietern AMD , um eine End-to-End-Lösung zu entwickeln, die sich nahtlos in die validierten KI integrieren lässt.

| Supermicro Stückliste Artikelnummer | SRS-48UAC-MI350-8U4N-R0 | SRS-48UAC-MI355-10U4N-R0 | SRS-48ULC-MI355-4U8N-R0 | SRS-52ULC-MI355-4U12N-R0 |

|---|---|---|---|---|

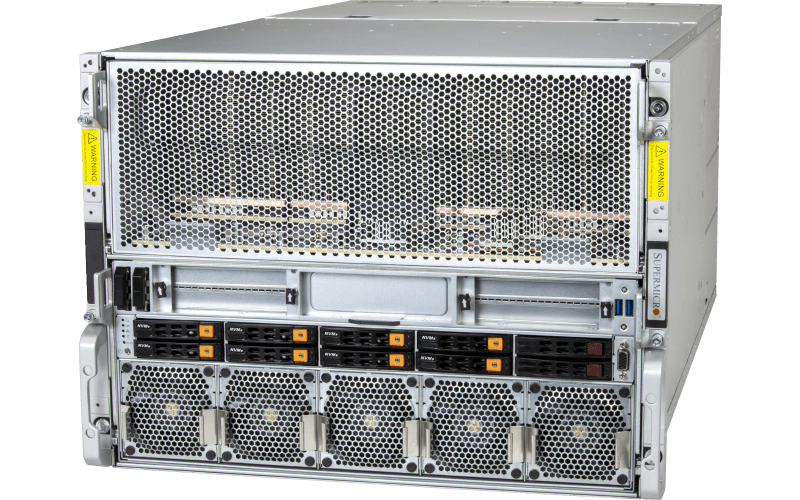

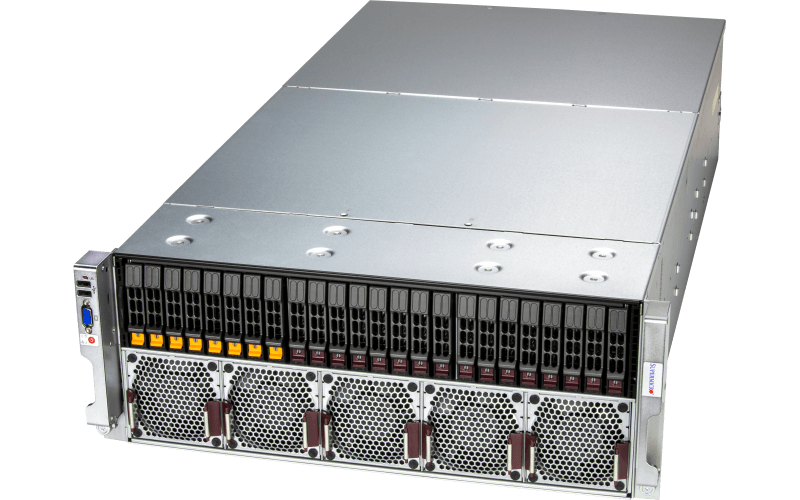

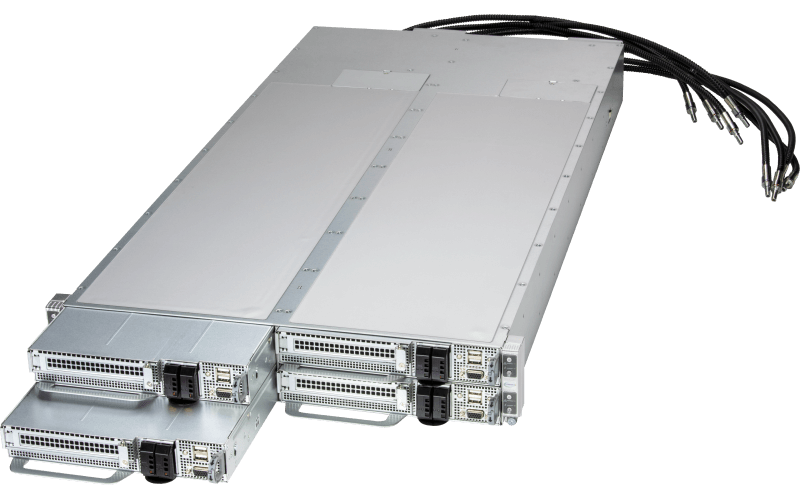

| Supermicro Server | AS -8126GS-TNMR | AS -A126GS-TNMR | AS -4126GS-NMR-LCC | AS -4126GS-NMR-LCC |

| Serverkühlung | Luft | Luft | Flüssig | Flüssig |

| GPU-Familie | MI350X | MI355X | MI355X | MI355X |

| Größe des Server-Clusters (S, M, L) | 4, 16, 64 | 4, 16, 64 | 4, 32, 64 | 8, 48, 128 |

| Anzahl der Instinct-GPUs | 32, 128, 512 | 32, 128, 512 | 32, 256, 512 | 64, 384, 1024 |

| Instinct-GPU-Modell | MI350X AC | MI355X AC | MI355X DLC | MI355X DLC |

| Anzahl der Pensando KI | 40, 160, 640 | 40, 160, 640 | 40, 320, 640 | 80, 480, 1280 |

| Leistung des Serverschranks (für mittlere Clustergröße) | 48,47 kW | 63,61 kW | 120,36 kW | 178,71 kW |