Was ist Edge Computing?

Edge-Computing ist ein dezentrales Rechenmodell, bei dem die Datenverarbeitung am Entstehungsort oder in dessen Nähe erfolgt, anstatt die Daten an ein zentrales Rechenzentrum oder eine Cloud-Umgebung zu übertragen. Dieser Ansatz steht im Gegensatz zu herkömmlichen Rechenarchitekturen, die stark auf zentralisierte Verarbeitung setzen, die oft weit entfernt von den Geräten stattfindet, die die Daten erzeugen.

In einem Edge-Computing-Framework finden die Datenanalyse und die Systemreaktionsfähigkeit viel näher an dem Ort statt, an dem die Daten generiert werden, unabhängig davon, ob diese aus IoT-Systemen, IoT-Edge-Sensoren oder industriellen Steuerungssystemen stammen. Dieser lokale Ansatz ermöglicht es den Systemen, autonomer zu arbeiten, sodass sie Daten interpretieren und darauf reagieren können, ohne auf eine ständige Kommunikation mit einer zentralen Cloud oder einem Rechenzentrum angewiesen zu sein.

Edge-Computing ist eng mit dem Konzept des „Intelligent Edge“ verbunden, bei dem Geräte am Netzwerkrand Daten in Echtzeit verarbeiten und analysieren und so eine intelligentere und schnellere Entscheidungsfindung ermöglichen. Diese Anwendungen fallen häufig unter den Oberbegriff „IoT-Anwendungen“, die darauf ausgelegt sind, die Vorteile lokaler Rechenkapazitäten für eine verbesserte Reaktionsfähigkeit zu nutzen.

Der Aufstieg des Edge-Computing spiegelt den wachsenden Bedarf wider, den massiven Datenstrom, der von verteilten Geräten generiert wird, in Echtzeit zu bewältigen. Da digitale Umgebungen immer komplexer und geografisch weiter verstreut werden, haben herkömmliche zentralisierte Architekturen oft Schwierigkeiten, die Anforderungen an Leistung und Skalierbarkeit zu erfüllen. Edge-Computing begegnet dieser Herausforderung, indem es Rechenkapazitäten auf verschiedene Punkte im Netzwerk verteilt, was schnellere Erkenntnisse und ein anpassungsfähigeres Systemverhalten ermöglicht.

Dieses dezentrale Modell stellt einen grundlegenden Wandel in der Art und Weise dar, wie Unternehmen moderne Anwendungen entwickeln und bereitstellen. Anstatt alle Verarbeitungsaufgaben an einen zentralen Standort zu leiten, ermöglicht Edge-Computing lokale Abläufe und unterstützt eine skalierbare, ausfallsichere Infrastruktur in verschiedenen Branchen – von der Fertigung und Logistik bis hin zum Gesundheitswesen und zu Smart Cities –, wobei häufig Zwischensysteme wie IoT-Gateways eingesetzt werden, um Edge-Geräte mit größeren Netzwerken zu verbinden.

So funktioniert Edge-Computing

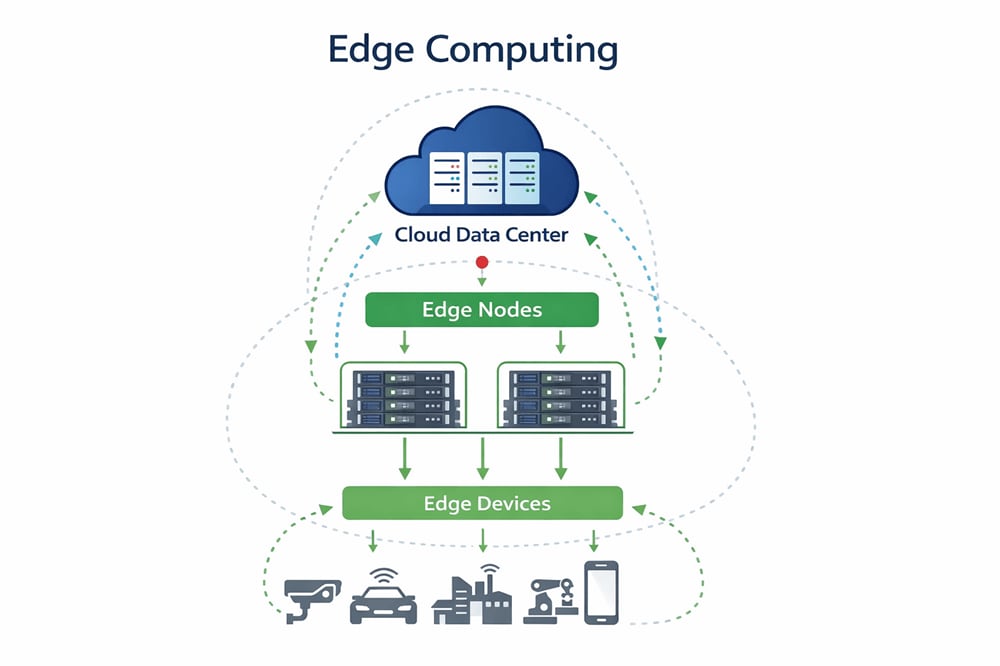

Edge-Computing funktioniert dadurch, dass wichtige Rechenaufgaben wie Datenanalyse und -verarbeitung von zentralisierten Rechenzentren an verteilte Standorte verlagert werden, die physisch näher an dem Ort liegen, an dem die Daten generiert werden. Bei dieser Verlagerung geht es nicht nur um geografische Aspekte, sondern um eine Umstrukturierung der Architektur, um zeitkritische Vorgänge zu unterstützen, die Abhängigkeit vom Netzwerk zu verringern und eine Entscheidungsfindung in Echtzeit direkt an der Quelle zu ermöglichen. Edge-Umgebungen bestehen in der Regel aus einem mehrschichtigen System, das Edge-Geräte, lokale Rechenknoten und Netzwerkkomponenten umfasst, die bei Bedarf mit zentralen Systemen zusammenarbeiten.

Moderne eingebettete Serverlösungen spielen im Bereich des Edge-Computing eine entscheidende Rolle. Diese Server sind auf Energieeffizienz ausgelegt und bieten gleichzeitig eine robuste Leistung, um den hohen Anforderungen von Edge-Computing-Aufgaben gerecht zu werden. Mit ihrem Bekenntnis zu umweltfreundlichem Computing zielen diese Lösungen darauf ab, die Umweltbelastung zu minimieren. Dies erreichen sie durch die Verringerung des CO₂-Fußabdrucks bei gleichzeitiger Maximierung der Betriebseffizienz.

Ebenso wichtig ist, dass diese Serverlösungen so konzipiert sind, dass sie auch unter schwierigen Umgebungsbedingungen zuverlässig arbeiten. Dies gewährleistet eine konsistente Leistung in einer Vielzahl von Umgebungen, einschließlich solcher mit extremen Temperaturen oder anderen anspruchsvollen Betriebsanforderungen. Die Vielseitigkeit und Belastbarkeit dieser Server macht sie ideal für eine Vielzahl von Edge-Computing-Anwendungen.

Edge-Computing-Systeme sind zudem in der Regel auf erhöhte Sicherheit ausgelegt, da sie sensible Daten häufig außerhalb der herkömmlichen IT-Perimeter verarbeiten. Lokale Sicherheitskontrollen, Verschlüsselung und Systemhärtung sind unerlässlich, um die Integrität und den Datenschutz der am Edge verarbeiteten Daten zu gewährleisten.

Durch den Einsatz von Rechenleistung näher am Ort der Datenerzeugung ermöglicht Edge-Computing schnellere Verarbeitungszeiten, entlastet die Netzwerkbandbreite und verbessert die Reaktionsfähigkeit digitaler Dienste und Geräte.

Verwandte Produkte und Lösungen

Verwandte Ressourcen

Edge-Computing vs. Cloud-Computing vs. Fog-Computing

Während sich Edge-, Cloud- und Fog-Computing alle darauf beziehen, wie und wo Daten verarbeitet werden, stellt jedes davon einen eigenständigen Ansatz für die Rechnerarchitektur dar, der sich durch unterschiedliche Anwendungsbereiche und Leistungsmerkmale auszeichnet.

Cloud Computing stützt sich auf zentralisierte Rechenzentren, die oft weit entfernt vom Ort der Datenerzeugung liegen. Bei diesem Modell werden Daten über ein Netzwerk (in der Regel das Internet) übertragen, um von Cloud-Dienstleistern verarbeitet, gespeichert und verwaltet zu werden. Dieser Ansatz bietet Skalierbarkeit und zentrale Kontrolle, kann jedoch zu Latenzzeiten und Bandbreitenbeschränkungen führen, insbesondere bei Echtzeitanwendungen oder Anwendungen mit hohem Datenaufkommen.

Im Gegensatz dazu werden beim Edge-Computing Daten lokal oder in der Nähe ihrer Quelle verarbeitet. Dieses Modell verkürzt die Übertragungswege und minimiert die Latenz, indem Informationen direkt auf dem Gerät oder einem nahegelegenen Edge-Knoten analysiert werden. Es eignet sich besonders für Anwendungsfälle, die sofortige Erkenntnisse oder Maßnahmen erfordern, wie beispielsweise autonome Systeme, industrielle Automatisierung oder Videoanalyse vor Ort.

Fog Computing fungiert als Vermittler zwischen Edge- und Cloud-Umgebungen. Es erweitert die Cloud-Fähigkeiten näher an den Edge, indem es eine Ebene verteilter Datenverarbeitung einführt, die zwischen lokalen Geräten und der zentralisierten Cloud-Infrastruktur arbeitet. Fog Computing hilft bei der Bewältigung von Aufgaben, die für Edge-Geräte zu ressourcenintensiv, für eine reine Cloud-Verarbeitung jedoch zu latenzempfindlich sind.

Im Wesentlichen ist Cloud-Computing zentralisiert, Edge-Computing vollständig dezentralisiert und Fog-Computing bietet einen hybriden Ansatz. Jedes Modell hat seinen Platz, je nach den spezifischen Anforderungen an Geschwindigkeit, Bandbreite, Datenhoheit und Rechenleistung.

Die wichtigsten Vorteile von Edge-Computing

Edge-Computing bietet zahlreiche strategische und operative Vorteile, die es zu einer überzeugenden Architektur für moderne datenintensive Anwendungen machen.

Einer der wichtigsten Vorteile ist die geringere Latenz. Da Daten direkt an der Quelle oder in deren Nähe verarbeitet werden, entfällt beim Edge-Computing die Notwendigkeit, Informationen über große Entfernungen an zentralisierte Systeme zu übertragen. Dies verkürzt die Reaktionszeiten erheblich, was für Echtzeitanwendungen wie autonome Fahrzeuge, Augmented Reality, industrielle Automatisierung und Ferndiagnosen in der Telemedizin von entscheidender Bedeutung ist.

Ein weiterer wesentlicher Vorteil ist die effiziente Nutzung der Bandbreite. Durch die lokale Datenverarbeitung können Systeme Daten filtern, analysieren und verarbeiten, bevor sie nur die wesentlichen Informationen an zentralisierte Cloud-Plattformen übermitteln. Dadurch wird das über das Netzwerk gesendete Datenvolumen minimiert, was den Bandbreitenverbrauch und die damit verbundenen Kosten senkt – besonders wertvoll in Umgebungen mit begrenzter oder teurer Konnektivität.

Verbesserte Sicherheit und Datenschutz sind ebenfalls wesentliche Merkmale des Edge-Computing. Die Verarbeitung von Daten vor Ort oder innerhalb der lokalen Infrastruktur verringert das Risiko, dass sensible Informationen während der Übertragung offengelegt werden. Dies kann das Risiko von Abfangversuchen oder unbefugtem Zugriff senken, insbesondere in Branchen mit strengen regulatorischen Anforderungen wie dem Gesundheitswesen, dem Finanzsektor und dem Bereich kritischer Infrastrukturen.

Schließlich trägt Edge-Computing zu einer höheren Systemzuverlässigkeit bei. Da Edge-Geräte und -Knoten unabhängig von der zentralen Cloud arbeiten können, sind sie auch bei Netzwerkstörungen oder -ausfällen weiterhin funktionsfähig. Diese lokale Ausfallsicherheit gewährleistet die Kontinuität der Dienste, selbst wenn die Verbindung zur zentralen Infrastruktur vorübergehend unterbrochen ist.

All diese Vorteile zusammen machen Edge-Computing zu einem leistungsstarken Ansatz für Unternehmen, die ihre Leistung steigern, Betriebsrisiken verringern und verteilte Umgebungen besser unterstützen möchten.

Anwendungsfälle und Einsatzbereiche

Edge-Computing ermöglicht die Verarbeitung vor Ort oder in unmittelbarer Nähe, was für Branchen, die schnelle Entscheidungsfindung und lokale Steuerung erfordern, mittlerweile von entscheidender Bedeutung ist. Die Fähigkeit, Rechenleistung näher an die Quelle der Datengenerierung heranzubringen, hat neue Innovationsmöglichkeiten eröffnet, insbesondere in Umgebungen, in denen Latenz, Zuverlässigkeit und Reaktionsgeschwindigkeit entscheidend sind.

In der Fertigung ermöglicht Edge-Computing vorausschauende Wartung, Qualitätskontrolle in Echtzeit und Produktionsoptimierung, indem Sensordaten direkt in der Fertigungshalle analysiert werden. Im Gesundheitswesen nutzen Systeme die Möglichkeiten des Edge-Computing, um Ferndiagnosen, Patientenüberwachung und medizinische Bildgebung in Umgebungen zu unterstützen, in denen geringe Latenzzeiten von entscheidender Bedeutung sein können. Im Einzelhandel unterstützt die Edge-Infrastruktur intelligente Kassensysteme, personalisierte Kundenerlebnisse und eine effiziente Bestandsverwaltung, indem Daten lokal in den Filialen verarbeitet werden.

Autonome Fahrzeuge sind in hohem Maße auf Edge-Computing angewiesen, um Sensordaten auszuwerten, Fahrentscheidungen zu treffen und mit der umgebenden Infrastruktur zu kommunizieren. All dies geschieht in Echtzeit und ohne ständige Cloud-Anbindung. Ebenso nutzen Smart-City-Initiativen Edge-Technologien, um Verkehrssysteme zu steuern, die Infrastruktur für die öffentliche Sicherheit zu überwachen und den Energieverbrauch auf lokaler Ebene zu optimieren.

Edge-Computing ist zudem eng mit der Verbreitung von IoT-Edge-Lösungen verbunden, bei denen Daten auf oder in der Nähe vernetzter Geräte verarbeitet werden. Diese Anwendungen sind vielfältig und nehmen stetig zu; ihre technischen Besonderheiten werden auf einer speziellen Glossarseite zum Thema IoT-Edge ausführlicher behandelt.

Als zentrale Triebkraft des verteilten Rechnens ermöglicht die Edge-Architektur Unternehmen, ihre IT-Fähigkeiten auf die physische Welt auszuweiten, was eine schnellere Entscheidungsfindung, widerstandsfähigere Systeme und skalierbare Bereitstellungsmodelle unterstützt. Von der industriellen Automatisierung über vernetzte Gesundheitssysteme bis hin zu intelligenten Verkehrssystemen spielt Edge-Computing eine entscheidende Rolle beim Aufbau schneller, effizienter und anpassungsfähiger digitaler Ökosysteme in modernen Unternehmen.

Herausforderungen und Überlegungen

Edge-Computing bietet zwar klare Vorteile in Bezug auf Geschwindigkeit, Skalierbarkeit und Effizienz, bringt jedoch auch eine Reihe einzigartiger Herausforderungen mit sich, denen sich Unternehmen stellen müssen, um eine erfolgreiche Implementierung und einen reibungslosen Betrieb zu gewährleisten.

Ein wichtiger Aspekt ist die Komplexität der Verwaltung. Da die Rechenressourcen auf mehrere Edge-Standorte verteilt sind, kann es zunehmend schwieriger werden, einheitliche Standards in Bezug auf Leistung, Sicherheit und Konfiguration aufrechtzuerhalten. Dies gilt insbesondere dann, wenn sich diese Standorte in abgelegenen oder räumlich begrenzten Umgebungen befinden. Um diese Herausforderung zu bewältigen, müssen IT-Teams eine Vielzahl unterschiedlicher Hardware-, Software- und Netzwerkkomponenten an dezentralen Standorten verwalten.

Sicherheit und Datenschutz sind ebenfalls von entscheidender Bedeutung. Zwar kann die lokale Datenverarbeitung das Risiko während der Übertragung verringern, doch sind Edge-Geräte und Knoten unter Umständen physisch leichter zugänglich oder werden außerhalb der herkömmlichen Sicherheitsperimeter von Unternehmen betrieben. Dies erhöht den Bedarf an robustem Endgeräteschutz, sicheren Startprozessen und Echtzeitüberwachung, um vor unbefugtem Zugriff oder Manipulationen zu schützen.

Eine weitere Herausforderung sind Interoperabilität und Standardisierung. In Edge-Umgebungen kommt häufig eine Vielzahl unterschiedlicher Geräte, Plattformen und Protokolle zum Einsatz. Die Gewährleistung der Kompatibilität zwischen diesen Komponenten – insbesondere in Umgebungen mit Geräten verschiedener Hersteller oder in Legacy-Umgebungen – kann sich sowohl auf die Integrationsbemühungen als auch auf die langfristige Skalierbarkeit auswirken.

Zudem können die Infrastrukturkosten erheblich sein. Zwar entlastet Edge-Computing die zentralen Rechenzentren, doch der großflächige Einsatz und die Wartung von Edge-Hardware erfordern Investitionen in robuste Systeme, zuverlässige Stromversorgungen und sichere Konnektivität. Die Kapitalrendite hängt stark vom Anwendungsfall, dem Umfang der Bereitstellung und der Betriebsstrategie ab.

Schließlich müssen Unternehmen den Datenlebenszyklus am Netzwerkrand berücksichtigen. Entscheidungen darüber, welche Daten lokal verarbeitet, welche verworfen und welche zur langfristigen Speicherung oder Analyse in die Cloud gesendet werden sollen, erfordern eine sorgfältige Planung und die Durchsetzung entsprechender Richtlinien, um einen Ausgleich zwischen Leistungsanforderungen und regulatorischen sowie geschäftlichen Vorgaben zu schaffen.

Schlüsselbegriffe des Edge Computing

Um die Funktionsweise verteilter Architekturen zu verstehen, ist es unerlässlich, die Kernkomponenten des Edge-Computing zu kennen. Im Folgenden sind einige wichtige Begriffe aufgeführt, die häufig im Zusammenhang mit Edge-Umgebungen verwendet werden:

Randknoten

Ein Edge-Knoten ist ein lokaler Rechenendpunkt, der von Geräten in der näheren Umgebung erzeugte Daten verarbeitet oder weiterleitet. Er dient in der Regel als erste Verarbeitungsschicht in der Edge-Computing-Hierarchie und ermöglicht so die Datenfilterung oder Entscheidungsfindung in Echtzeit näher an der Quelle.

Gateway

Ein Gateway fungiert als Brücke zwischen Edge-Geräten und zentralen Netzwerken oder Systemen. Es verwaltet den Datenverkehr, übernimmt die Protokollübersetzung und führt häufig grundlegende Verarbeitungs- oder Sicherheitsaufgaben durch, bevor es Daten weiterleitet.

Mikro-Rechenzentrum

Mikro-Rechenzentren sind kompakte, eigenständige Einrichtungen, die Rechen-, Speicher- und Netzwerkressourcen in unmittelbarer Nähe zum Einsatzort bereitstellen. Sie unterstützen bestimmte Anwendungen oder lokale Arbeitslasten und verringern so die Notwendigkeit, Daten an weit entfernte Rechenzentren zu übertragen.

Edge-Gerät

Ein Edge-Gerät ist ein Endgerät – beispielsweise ein Sensor, eine Kamera oder eine industrielle Steuerung –, das in einer Edge-Computing-Umgebung Daten generiert oder nutzt. Diese Geräte verfügen häufig über begrenzte Rechenkapazitäten, um Reaktionen in Echtzeit zu ermöglichen.

Edge-Orchestrator

Ein Edge-Orchestrator ist eine Software-Schicht oder Plattform, die Workloads über mehrere Edge-Knoten hinweg verwaltet, bereitstellt und überwacht. Er ermöglicht die zentrale Steuerung einer dezentralen Infrastruktur und trägt so zur Wahrung von Konsistenz und Skalierbarkeit bei.

Latenz

Im Edge-Computing bezeichnet Latenz die Verzögerung zwischen dem Zeitpunkt, zu dem Daten generiert werden, und dem Zeitpunkt, zu dem sie verarbeitet oder genutzt werden. Die Verringerung der Latenz ist eines der Hauptziele der Ansiedlung von Rechenressourcen in größerer Nähe zur Datenquelle.

Echtzeitverarbeitung

Dieser Begriff bezeichnet die Fähigkeit eines Systems, Daten innerhalb von Millisekunden zu erfassen, zu analysieren und darauf zu reagieren. Edge-Computing unterstützt die Echtzeitverarbeitung, indem es Übertragungsverzögerungen minimiert und eine sofortige lokale Berechnung ermöglicht.

FAQs

- Was ist der Unterschied zwischen Edge-Computing und Cloud-Computing?

Obwohl sowohl beim Edge-Computingals auch beim Cloud-ComputingDaten gespeichert und verarbeitet werden, liegt der Hauptunterschied im Standort. Beim Cloud-Computing wird die Verarbeitung in großen Rechenzentren zentralisiert, die oft weit entfernt von den Endnutzern liegen. Im Gegensatz dazu werden beim Edge-Computing Daten näher an dem Ort verarbeitet, an dem sie entstehen. - Inwiefern verbessert Edge-Computing das IoT?

Edge-Computing ergänzt das IoT, indem es Geräten ermöglicht, Daten lokal zu verarbeiten und zu analysieren, anstatt sie zur Verarbeitung an eine zentrale Cloud zu senden. Dies ermöglicht eine schnellere Entscheidungsfindung – ein entscheidender Vorteil für zeitkritische Anwendungen wie industrielle Automatisierung, Smart Cities oder autonome Systeme. - Ist Edge-Computing sicherer als Cloud-Computing?

Edge-Computing kann den Datenschutz und die Datensicherheit verbessern, indem es die Übertragungswege für sensible Daten begrenzt und so das Risiko während der Übertragung verringert. Allerdings bringt es auch neue Sicherheitsherausforderungen mit sich, wie beispielsweise die Verwaltung einer großen Anzahl verteilter Endpunkte. Sowohl Edge- als auch Cloud-Umgebungen erfordern umfassende, kontextspezifische Sicherheitsstrategien. - Warum ist Edge-Computing für 5G wichtig?

Edge-Computingist für 5G-Netze unverzichtbar, da es dazu beiträgt, die Latenz zu verringern. Da 5G eine schnellere Datenübertragung ermöglicht, sorgt die Edge-Infrastruktur dafür, dass die Verarbeitung Schritt halten kann, insbesondere bei mobilen und bandbreitenintensiven Anwendungen. - Was sind Beispiele für Edge-Computing im Alltag?

Zu den Beispielen für Edge-Computing in der Praxiszählen autonome Fahrzeuge, die Sensordaten in Echtzeit verarbeiten, Einzelhandelsgeschäfte, die Analysen zum Kundenverhalten nutzen, sowie Industrieanlagen, die vorausschauende Wartungssysteme in der Fertigung einsetzen. Diese Szenarien erfordern eine sofortige Datenverarbeitung, ohne auf weit entfernte Rechenzentren angewiesen zu sein.