スケーラブルで俊敏なインフラストラクチャにより、アプリケーションの開発およびデプロイを加速するように設計されています。

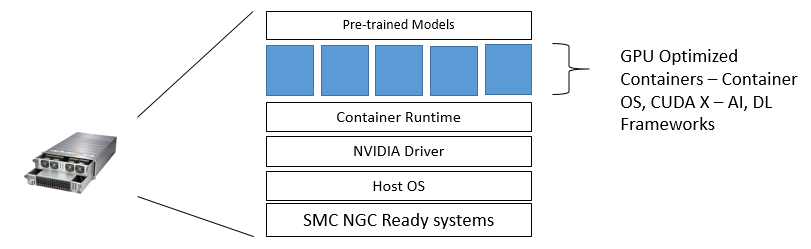

Supermicro システムSupermicro 、NVIDIA NGCのAIソフトウェアの機能性とパフォーマンスについて検証済みです。これらのシステムとNVIDIA NGCを組み合わせることで、お客様はエンドツーエンドのAIソリューションを開発・導入することが可能になります。システムには、NVIDIA NGCソフトウェアの実行に必要なオペレーティングシステム、コンテナ、CUDA環境がプリインストールされています。Supermicro 、追加サービスとしてNVIDIA NGCソフトウェアのインストールSupermicro 。 ハードウェアおよびオペレーティングシステムに対するエンタープライズグレードのサポートが利用可能であり、システム管理者がシステムのダウンタイムを最小限に抑えるのを支援し、ユーザーがAIワークロードを安心して運用できるようサポートします。

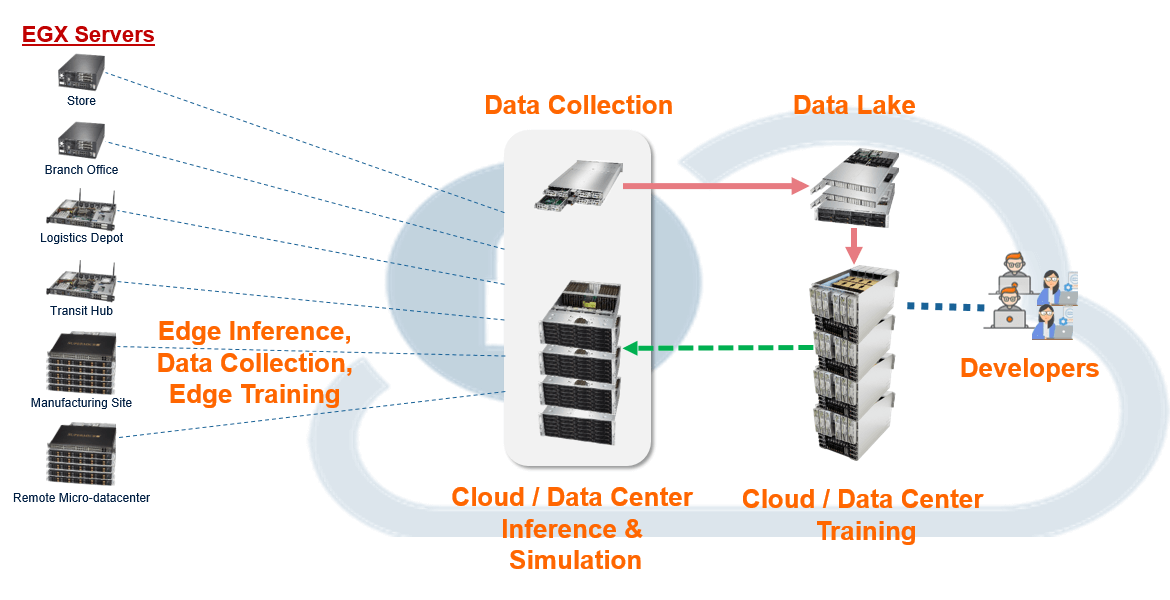

NVIDIA V100およびT4を搭載したSupermicro システムは、トレーニング 推論の両方で処理速度の向上を実現します。NVIDIA NGCソフトウェアはDockerコンテナとして提供されるため、Supermicro システムが導入されている場所であればどこでも実行可能です:

- データセンターやクラウド

- エッジ・マイクロデータセンター

- 環境に強くセキュアなEGXサーバーとして、分散した遠隔地に設置可能

最先端のコンピューティングソリューションを提供してきた26年の実績に裏打ちされたSupermicro 、今日の市場において、最も電力効率に優れ、最高のパフォーマンスとコストパフォーマンスを兼ね備えたサーバーソリューションです。ultraネットワークやストレージ、さらにはNVIDIA V100およびT4 GPUに対応したSupermicro システムは、AIをサポートする上で最もスケーラブルかつ信頼性の高いサーバーです。お客様は安心してAIインフラストラクチャを運用することができます。

エヌビディアNGC

NGCは、NVIDIAが提供するGPU加速AI、機械学習(ML)、およびHPCアプリケーション向けのコンテナ、SDK、ツールのハブであり、パフォーマンスが最適化されたソフトウェアへのアクセスを迅速化します。

NGCコンテナレジストリでは、NVIDIAによって調整、テスト、最適化された主要なAIおよびデータサイエンスソフトウェア用のコンテナに加え、HPCアプリケーションやデータ分析向けに徹底的にテストされたコンテナを提供しています。これらのコンテナは、オンプレミスおよびクラウドにおけるNVIDIA GPUの性能を最大限に活用します。各コンテナは完全に最適化されており、NVIDIA GPUを搭載した幅広いSupermicro ソリューションで動作します。

NVIDIA NGCでは、データサイエンティストが高精度なモデルをより迅速に構築できるよう、事前学習済みモデルも提供しています。また、トレーニング 推論備えたエンドツーエンドのAIソリューションの開発を簡素化する、業界特化型のSDKも提供しています。

NVIDIAは、高性能GPUアクセラレータと、AIソフトウェア開発と展開のためのソフトウェアにおけるリーダーです。最新のAI研究の技術をNGCに取り入れることで、お客様はAIアプリケーションを開発するための最良の選択肢を得たと確信することができます。事前に訓練されたAIモデルと転移学習により、お客様はNGCを使用することで、以前よりもはるかに迅速にAIソリューションを開発することができます。

Supermicro システムのメリット

Supermicro システムSupermicro 、NGCコンテナを実行するための性能と機能について検証済みです。NVIDIA NGCソフトウェアと組み合わせることで、ハイエンドのNGC-Readyシステムは、高速ネットワークとストレージを介してGPUを統合し、大規模なデータバッチを用いた大規模AIモデルのトレーニングを行うことができます。エッジ向けNGC-Readyシステムは、AI推論のためのAIアプリケーションを展開します。

Supermicro システムでは、以下の機能やサービスも提供されています:

- 性能検証済みのシステムにより、解決までの時間が短縮され、IT管理者は適切なAIワークロードに適したシステムを選択できます。

- Supermicro 、システムの電源投入直後からAIソフトウェアの開発を開始できるオプションSupermicro 。オペレーティングシステム、CUDA、CUDA-X、NVIDIAドライバー、およびコンテナインフラストラクチャがプリロードされています

- NVIDIA NGCが提供する最新の最先端ディープラーニングAIモデルにアクセスできます。事前に訓練されたモデルとお客様独自のデータを使用して、新しいAIモデルを効率的に構築できます。

- NGCコンテナは、データセンター内のSupermicro 、エッジマイクロデータセンター、エッジサーバー、そしてクラウド クラウド など、あらゆる場所で動作します。Kubernetesは、本番環境におけるコンテナのデプロイ、スケーリング、および管理を自動化します

- ハードウェア、OS、NVIDIA NGCのサポートサービスをご利用いただけます。

- ラック、サーバー、ストレージ、ネットワークのセットアップサービス

- マルチサーバー展開のためのKubernetesコンサルティングサービス

Supermicro 、AI/DLソリューションスタックの一環として、エンタープライズレベルのサポートを含む「NGC-Readyシステム」Supermicro 。詳細につきましては、Supermicro 担当までお問い合わせください。

Supermicro NGC – ソリューションアーキテクチャ

Supermicro Readyシステムは、大規模なトレーニング からデータセンター推論、エッジ推論 トレーニング 、お客様のAIインフラストラクチャ全体を運用するのをサポートします。

Supermicro システム

Supermicro NVIDIA GPUクラウド NGC) サーバー。こちらをご確認ください こちら 最新の公開リストをご確認ください。

|  |  |  |  |  | |

トレーニング推論 データセンターエッジ | ||||||

| SYS-4029GP-TVRT | SYS-2029GP-TR | SYS-2029GP-TR | SYS-1019D-FHN13TP | システム-E403-9P-FN2T | システム-5019D-FN8TP | |

| CPU | 2 *Xeon スケーラブル | 2 *Xeon スケーラブル | 2 *Xeon スケーラブル | 1 *Xeon D | 1 *Xeon D | 1 *Xeon D |

| アクセラレーター | 8 * V100 NVLink | 2 * V100 | 4 * T4 | 2 * T4 | 2 * T4 | 1 * T4 |

| メモリー | 6 | 4 | 4 | 512 | 512 | 512 |

| ストレージ | 16 * SATA3;8 *NVMe | SATA 3 × 8;NVMe× 2 | SATA 3 × 8;NVMe× 2 | 4 * SATA3 | 4 * SATA3 | 4 * SATA3 |

| ネットワーク | 100GbE、GPUダイレクトRDMA | 100GbE、GPUダイレクトRDMA | 100GbE、GPUダイレクトRDMA | 10GbE、10GSFP | 10GbE、10GSFP | 10GBase-T、10GSFP |

| フォームファクター | 4Uラックマウント | 2Uラックマウント | 2Uラックマウント | ショート・デプス | ボックスPC、ショートデプス | 壁掛け |